Ko starš prejme paničen klic z otrokovim glasom, ki prosi za pomoč

Video, ki kaže politika, kako priznava podkupovanje. Posnetek slavne osebe, ki izreče nekaj škandaloznega. Fotografija otroka, ki nikoli ni obstajal. V svetu, kjer lažne podobe niso več le montaže, temveč globoko ponarejene stvarnosti – tako imenovane »deepfakes«, postaja vprašanje zaupanja v videno bolj ključno kot kadarkoli prej.

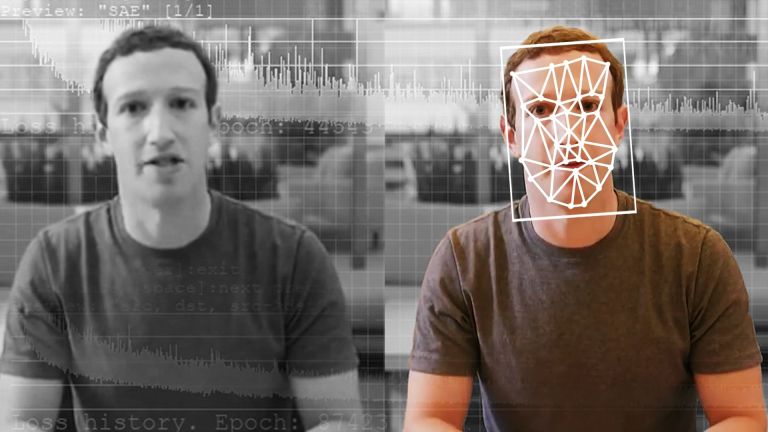

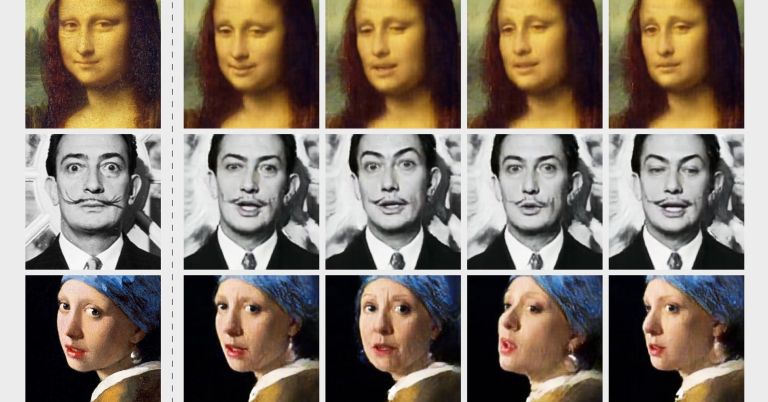

»Deepfake« je tehnologija, ki temelji na umetni inteligenci in s pomočjo globokega učenja ustvarja lažne, a izjemno prepričljive videe, avdioposnetke in fotografije. Gre za digitalne ponaredke, ki so tako dobro izdelani, da pogosto tudi strokovnjaki težko ločijo med resničnim in ponarejenim. Algoritmi za deepfake se učijo iz množičnih podatkov – na tisoče fotografij, videoposnetkov, zvokov in govornih vzorcev – in nato poustvarijo obrazne izraze, gibanje ustnic, ton glasu ter celo način govora določene osebe. Posledica je posnetek, ki gledalcu daje vtis, da je oseba nekaj izjavila ali storila, čeprav se to v resnici nikoli ni zgodilo.

Čeprav se je tehnologija sprva uporabljala predvsem za eksperimentiranje in zabavo – na primer za »zamenjavo obrazov« v filmskih prizorih – je hitro postala orodje za manipulacijo, izsiljevanje in propagando. Najprej so se pojavili ponarejeni pornografski videoposnetki, v katerih so bili brez soglasja zlorabljeni obrazi znanih osebnosti. Šokantno pa je, da so se ti posnetki razširili tudi med širšo populacijo, pri čemer so bile ženske najpogostejše tarče. Deepfaki so nato dobili še bolj nevarno vlogo v političnih in družbenih konfliktih.

Leta 2019 je v Gabonu novoletni televizijski nagovor predsednika Alija Bonga, ki se je po daljši odsotnosti zaradi bolezni znova pojavil v javnosti, sprožil val ugibanj. Posnetek je deloval nenavadno – predsednikova govorica in videz sta bila tako nenaravna, da so številni verjeli, da gre za deepfake. Ker oblasti niso ponudile prepričljive razlage, se je nezaupanje razširilo in v ozračju negotovosti je vojaška skupina izvedla poskus državnega udara. Čeprav se je kasneje izkazalo, da je bil video pristen, so dvomi ostali, s tem pa tudi občutek, da lahko ponarejena resničnost povzroči zelo resnične posledice.

Takšni primeri kažejo, da ne gre več le za tehnično zanimivost ali spletno šalo. Deepfake postaja sredstvo, s katerim je mogoče širiti dezinformacije, uničiti ugled posameznikov, spodkopavati zaupanje v institucije in vplivati na politične odločitve. Verodostojnost informacij v digitalni dobi ni več samoumevna. Vprašanje, kaj je res in kaj ne, se vse pogosteje seli iz sveta fikcije v vsakdanje življenje. In prav tu je razlog za zaskrbljenost: ko ne moremo več verjeti lastnim očem, postane celoten družbeni temelj, utemeljen na zaupanju, resno ogrožen.

Vpliv na demokracijo in javni diskurz

Vpliv deepfake tehnologije na politično sfero ni več hipotetičen, temveč že povsem oprijemljiv. V Združenih državah Amerike so se v zadnjih volilnih ciklih pojavili videoposnetki, na katerih kandidati izrekajo neprimerne ali škandalozne izjave, ki jih v resnici nikoli niso podali. Čeprav so bilinekateri posnetki kasneje označeni kot ponarejeni, je bila škoda že narejena. V času, ko se vsebine bliskovito širijo po družbenih omrežjih, je dovolj že nekaj sekund, da se dvom zaseje, ugled omaje in odločitev volivcev spremeni. Deepfake tako ne napada le posameznih političnih akterjev, temveč vzbuja splošno nezaupanje v politični sistem kot celoto.

Zmožnost ustvarjanja popolnoma verodostojnih, a neresničnih izjav, nastopov ali celo kriznih situacij pomeni, da lahko kdorkoli, ki ima dostop do dovolj zmogljivih orodij, vpliva na javno mnenje, razpihuje polarizacijo in manipulira s čustvi množic. Laž, če je le dovolj dobro zapakirana, se danes razširi hitreje kot preverjeno dejstvo.

Evropska unija je poskušala na to nevarnost odgovoriti z uvedbo Akta o digitalnih storitvah (DSA), ki od februarja 2024 zavezuje velike spletne platforme k večji odgovornosti. Med drugim zahteva označevanje umetno ustvarjenih vsebin, večjo preglednost algoritmov, hitrejše odstranjevanje nezakonitih objav in boljše varovanje uporabnikov. Zakon daje tudi poudarek zaščiti volilnih procesov in preprečevanju širjenja dezinformacij, še posebej v predvolilnem času.

A kljub temu številni strokovnjaki opozarjajo, da zakonodaja pogosto zaostaja za izjemno hitrim razvojem tehnologij umetne inteligence. Deepfake orodja postajajo vedno bolj dostopna in preprosta za uporabo, kar pomeni, da za manipulacijo ne potrebuješ več vrhunskega znanja ali obsežnih virov. Dovolj je že mobilni telefon in ustrezna aplikacija. Prav tako ostaja v večini primerov reaktivno, saj ukrepa šele, ko se škoda že zgodi.

Ko laž postane bolj prepričljiva od resnice

Antropolog dr. Dan Podjed opozarja, da deepfake ni osamljen pojav, temveč simptom širšega problema, izgube stika z realnostjo. Po njegovih besedah ne živimo več le v svetu, kjer gledamo resničnost skozi zaslon, temveč vse bolj v svetu, kjer zasloni ustvarjajo lastno resničnost. Poudarja, da deepfake ni le tehničen problem, ampak tudi etični in družbeni. Z umetno inteligenco lahko ustvarimo iluzijo človeškosti, ki postane celo bolj prepričljiva od dejanskega človeka.

Opozarja tudi na nevarnost imitacije čustev, saj umetna inteligenca že danes zna zavzdihniti, narediti premor, uporabljati mašila in s tem še bolj prepričljivo posnemati človeško komunikacijo. Če bomo bolj verjeli umetni inteligenci kot drug drugemu, bomo po njegovem mnenju zamenjali resnične odnose za digitalne iluzije.

Otroci – med občutljivimi tarčami

Med najbolj ranljivimi tarčami tehnologije deepfake so prav otroci in mladostniki. Gre za skupino, ki se še razvija, nima dovolj znanja za prepoznavanje manipulacij, hkrati pa je pogosto brez zaščite pred najnevarnejšimi zlorabami. V tujini so že dokumentirani primeri, ko so napadalci uporabili umetno ustvarjene glasove otrok za izsiljevanje njihovih staršev. Starši so prejeli panične klice, v katerih naj bi njihov otrok jokal in prosil za pomoč, pogosto z dodanimi zvoki, ki so ustvarjali vtis ugrabitve. Kasneje se je izkazalo, da gre za popolnoma ponarejene zvoke, generirane z umetno inteligenco. Čeprav otrok v resnici ni bil ogrožen, so bile posledice za starše in družino travmatične.

Tovrstne taktike predstavljajo novo raven digitalnega kriminala – izsiljevanje, ki cilja na najgloblje čustvene točke človeka: strah za lastnega otroka. Vzporedno s tem se razvija tudi skrb vzbujajoč trendgeneriranja lažnih fotografij otrok v neprimernih in celo spolno eksplicitnih okoliščinah. Storilci za to ne potrebujejo več neposrednega dostopa do otroka, dovolj je že javno dostopna fotografija obraza ali telesa. Umetna inteligenca nato »ustvari« prizore, ki niso resnični, a so videti povsem prepričljivo. Žrtve se lahko znajdejo v ponižujočih situacijah, ne da bi za to sploh vedele.

Zaradi vsega tega strokovnjaki vse bolj opozarjajo, da ima vsaka objavljena fotografija otroka lahko dolgoročne posledice. Na videz nedolžne fotografije s plaže, rojstnega dne ali družinskega izleta so lahko osnova za digitalno zlorabo. Algoritmi prepoznavajo obraze, zbirajo vzorce vedenja in ustvarjajo »digitalni odtis«, ki se ga otrok nikoli ne more povsem znebiti.

Starši se pogosto ne zavedajo, da z objavo teh fotografij ne predajajo le dragocenih spominov širšemu krogu prijateljev, ampak tudi množicam neznancev, med katerimi so lahko tudi zlonamerni posamezniki. Podatki, ki jih naložimo na platforme, postanejo del njihovih baz – dostopnih, obdelanih, analiziranih in včasih celo prodanih. S tem pa se izgublja ključni element zasebnosti, še preden otrok sploh dobi možnost, da o njej zavestno odloča.

Ko podvomimo o lastnih čutilih

Deepfake tehnologija ne ustvarja le dvoma o drugih, temveč tudi o nas samih. Učinek »lažne resničnosti«, kot ga imenujejo strokovnjaki, povzroči, da posamezniki ne vedo več, ali naj zaupajo temu, kar vidijo in slišijo. Psihologi opozarjajo, da to zmanjšuje zmožnost presoje, spodbuja teorije zarote in povečuje občutek nemoči.

Podjed opozarja, da smo kot družba postali hiperpovezani, a hkrati izjemno osamljeni. Ljudje pogosto iščejo tolažbo v umetni inteligenci, ker jim ta nudi takojšen odgovor, čustveno odzivnost in iluzijo prijateljstva – tudi takrat, ko gre zgolj za programiran odziv. V prihodnosti, pravi, ne bo presenečenje, če bo umetna inteligenca postala edini sogovornik številnih ljudi, ki ne bodo več znali navezati stika s sočlovekom.

Kaj lahko storimo?

Čeprav se zdi svet deepfaka zastrašujoč, obstajajo načini za zaščito. Po mnenju številnih strokovnjakov je ključno, da se ne odzivamo impulzivno in ne verjamemo slepo vsemu, kar kroži po spletu. Kritično mišljenje, preverjanje virov in zavedanje, da tudi tehnologija lahko vara, so nujni za preživetje v digitalni realnosti.

Pomembno je, da zmanjšamo svojo digitalno sled, ne objavljamo osebnih podatkov in slik, še posebej otrok, ter da podpiramo digitalno pismenost – tako v šolah kot doma. Kot pravi Podjed, je prihodnost lahko svetla, če ostanemo priklopljeni na ljudi in ne na naprave. Tehnologijo moramo znati uporabiti tako, da nam služi, ne da nas zasužnji.

Prva stran dneva

Dnevni izbor najpomembnejših zgodb doma in po svetu, dostavljen neposredno v vaš e-poštni nabiralnik.